ChatGPT argumentacja kontra człowiek: kiedy ufać AI w dyskusji

Zastanawiałeś się kiedyś, czy argumenty generowane przez sztuczną inteligencję naprawdę mają moc przekonywania, czy to tylko sprytna iluzja? Chatgpt argumentacja staje się tematem gorących debat – od uniwersytetów, przez sale konferencyjne, po zwykłe rozmowy na czacie. W dobie, gdy AI wdziera się w kolejne sfery życia, coraz trudniej odróżnić rzeczową argumentację od pozornie logicznych twierdzeń generowanych przez algorytm. Ten artykuł burzy mity, odkrywa kulisy działania AI i bezlitośnie obnaża jej ograniczenia. Zyskasz dostęp do faktów, które nie zawsze trafiają do mainstreamu, poznasz realne przykłady i praktyczne zastosowania, a także dowiesz się, gdzie czai się ryzyko. Jeśli myślisz, że czatgpt argumentacja to bezdyskusyjna rewolucja – przygotuj się na kilka niewygodnych prawd. To nie jest kolejny laurkowy tekst o AI. To brutalny portret systemu, który może zmienić sposób, w jaki się spieramy, myślimy i… dajemy się przekonać.

Dlaczego wszyscy mówią o argumentacji AI?

Nowa era dyskusji: AI w centrum debaty

Sztuczna inteligencja na przestrzeni ostatnich lat z impetem wkroczyła do świata debaty i argumentacji, redefiniując pojęcie merytorycznej dyskusji. ChatGPT oraz inne zaawansowane modele językowe przenoszą rozmowę na nowy poziom – oferują natychmiastowe, logicznie poskładane wypowiedzi, wzbogacone o dane i przykłady z całego świata. Według licznych analiz, AI już teraz uczestniczy w generowaniu argumentów w edukacji, biznesie i polityce, stając się nieformalnym „partnerem” w debatach publicznych. Paradoks? Choć systemy te nie odczuwają emocji, potrafią zagrać na ludzkich słabościach, precyzyjnie dobierając treści do konkretnej sytuacji. Jak zauważa Antyweb, 2023, AI wywołuje rosnące kontrowersje, bo coraz częściej przekracza granice, które dotąd zarezerwowane były dla ludzi.

Nie chodzi już tylko o automatyczne odpowiedzi na proste pytania. Chatgpt argumentacja staje się narzędziem do przekonywania, budowania narracji, a nawet… manipulacji. W opinii wielu ekspertów, AI potrafi przejmować kontrolę nad tokiem dyskusji, sprawnie rozpoznaje niuanse retoryczne i logiczne, a jednocześnie nie jest wolna od fundamentalnych błędów. Czy używanie czatgpt do argumentacji to wciąż niewinna rozrywka, czy już poważne narzędzie, które może zmienić zasady gry w debacie społecznej? Dzisiejsze realia nie pozostawiają złudzeń – ignorowanie wpływu AI na argumentację to przepis na bycie w tyle.

Statystyki – jak często Polacy korzystają z AI do argumentacji?

W Polsce korzystanie z AI do wspomagania argumentacji rośnie z miesiąca na miesiąc. Najnowsze badania przeprowadzone w 2024 roku przez Human360 wykazują, że już ponad 35% użytkowników internetu regularnie korzysta z narzędzi AI przy przygotowywaniu prezentacji, esejów czy… wymianie zdań na forach. Ten trend jest szczególnie widoczny wśród studentów i pracowników korporacji, gdzie presja na szybkie i przekonujące argumenty bywa ogromna. Warto zwrócić uwagę, że aż 21% badanych przyznaje się do korzystania z AI przy rozwiązywaniu konfliktów rodzinnych czy negocjacjach zakupowych.

| Zastosowanie AI do argumentacji | Odsetek użytkowników (%) | Najczęstsza grupa wiekowa |

|---|---|---|

| Eseje i prace naukowe | 38 | 18-24 |

| Prezentacje biznesowe | 32 | 25-40 |

| Dyskusje online | 28 | 18-34 |

| Negocjacje codzienne | 21 | 25-44 |

| Rozwiązywanie konfliktów | 15 | 25-54 |

Tabela 1: Najpopularniejsze zastosowania AI do argumentacji wśród Polaków w 2024 r. Źródło: Human360, 2024

Te dane nie pozostawiają złudzeń – sztuczna inteligencja jest już integralną częścią debaty społecznej, choć realna skala jej wpływu bywa często niedoceniana. Co ciekawe, Polacy doceniają szybkość i wygodę, ale coraz częściej wyrażają obawy przed „zawłaszczaniem” narracji przez AI. Widać, że technologia nie tylko ułatwia życie, ale i prowokuje do refleksji nad etyką argumentacji.

Czatgpt w codziennych rozmowach – realne przykłady

W praktyce, chatgpt argumentacja nie ogranicza się do sal wykładowych czy biurowych open space’ów. Przykłady płyną z życia: od rodzinnych kłótni o wybór filmu, po negocjacje dotyczące podziału obowiązków domowych. Jak podkreśla ekspert cytowany przez AIMarketing, 2024, „AI bywa skuteczniejsze w logicznym układaniu argumentów niż wielu dorosłych – ale to człowiek nadaje sens dyskusji”.

"Zdarzało się, że w rodzinnej rozmowie korzystałem z chatgpt, by znaleźć mocne argumenty za swoim pomysłem – i faktycznie, przekonałem domowników! Ale czasem AI daje odpowiedzi zbyt idealne, przez co łatwo wyczuć sztuczność." — Michał R., użytkownik czatgpt (przykład z badania Human360)

Z powyższego cytatu wybrzmiewa kluczowa prawda: AI może zwiększyć skuteczność argumentacji, ale nie zastąpi autentyczności i empatii – elementów fundamentalnych dla głębokiego porozumienia.

Jak działa chatgpt argumentacja od kulis?

Transformery i modele językowe – uproszczone wyjaśnienie

Pod maską chatgpt kryje się matematyczna machina, która przetwarza miliardy słów, ucząc się rozpoznawać wzorce i budować argumenty na podstawie prawdopodobieństwa. Najważniejszą rolę odgrywa tu architektura transformer, będąca przełomem w świecie NLP (przetwarzania języka naturalnego). Według OpenAI, 2023, transformery pozwalają na analizę kontekstu nie tylko pojedynczych słów, ale całych fragmentów tekstu. Dzięki temu AI „rozumie” niuanse, wyłapuje podteksty i potrafi logicznie łączyć fakty.

Definicje kluczowych terminów:

Innowacyjna architektura sieci neuronowej zaprojektowana do przetwarzania sekwencji danych (np. tekstów), która wykorzystuje mechanizm tzw. „uwagi” (attention), pozwalający modelowi skupiać się na odpowiednich fragmentach tekstu, by budować spójne i logiczne argumenty.

System uczący się zależności między słowami, zdaniami i kontekstami na podstawie gigantycznych zbiorów tekstów. Taki model przewiduje kolejne słowa, bazując na wcześniejszych frazach, co umożliwia generowanie argumentów zbliżonych do ludzkich.

W skrócie: chatgpt argumentacja to nie magia, lecz matematyka na sterydach. Model nie posiada świadomości ani własnych opinii – bazuje wyłącznie na tym, czego został nauczony i co statystycznie „pasuje” do zadanego promptu.

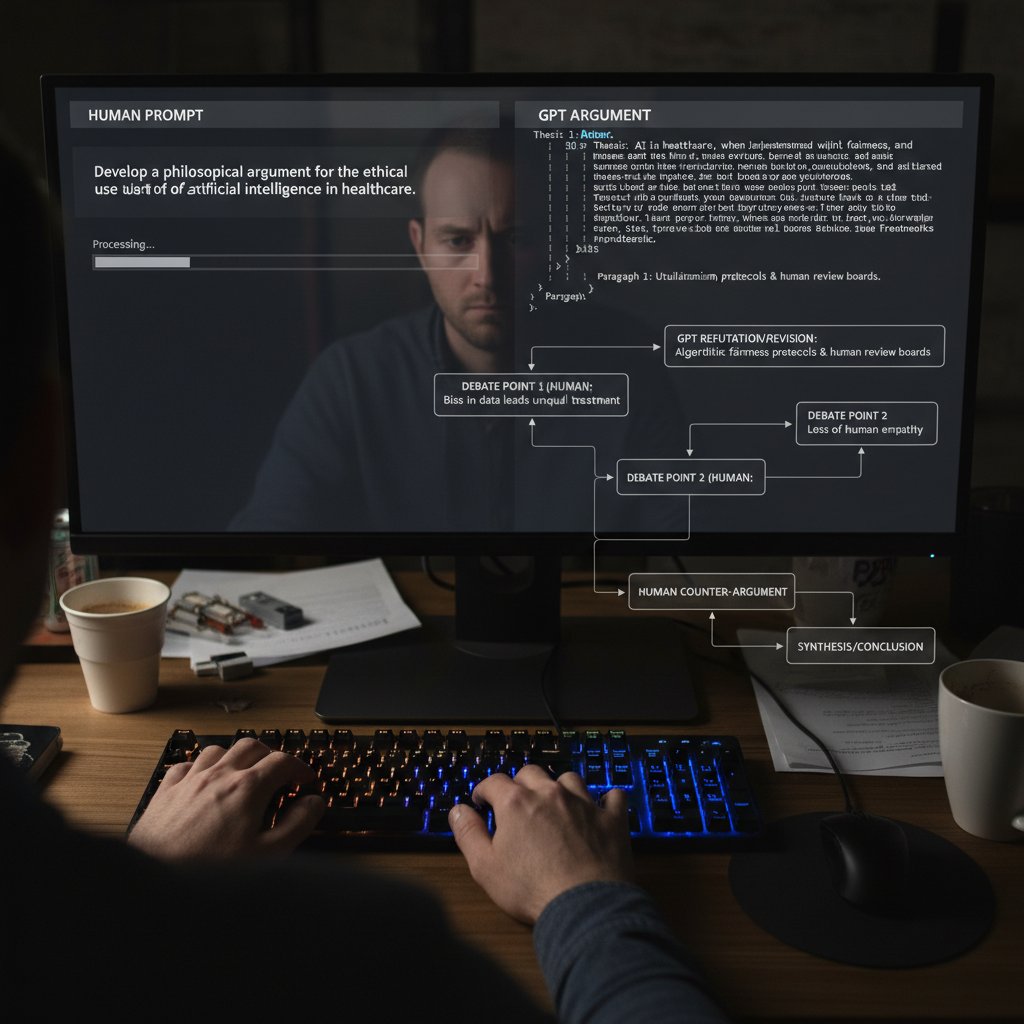

Od promptu do argumentu: tajemnice procesu

Proces generowania argumentu przez AI rozpoczyna się od promptu – pytania, tezy lub prośby użytkownika. Model analizuje zadane polecenie, identyfikuje kluczowe słowa i szuka powiązań w swoim „doświadczeniu” (czyli danych treningowych). Następnie wybiera najbardziej odpowiednie elementy, tworząc logiczny ciąg przyczynowo-skutkowy. Ciekawostką jest fakt, że nawet niewielka zmiana w promptcie może diametralnie zmienić strukturę i siłę argumentu. AI nie rozumie treści w sensie ludzkim – działa na zasadzie przewidywania, co „powinno” paść jako kolejny element wypowiedzi.

Kiedy prompt jest niejednoznaczny lub odnosi się do kontrowersyjnych tematów, chatgpt potrafi albo przyjąć „bezpieczną” pozycję, albo – co zdarza się coraz częściej – generować przekonujące, ale potencjalnie błędne argumenty. Przypadki tzw. halucynacji AI (tworzenia nieprawdziwych informacji) są wciąż dużym wyzwaniem, co potwierdzają badania Bankier.pl, 2024.

W praktyce oznacza to, że AI może skonstruować wiarygodny, logiczny argument nawet na temat, o którym nie posiada rzetelnych danych – wyłącznie na podstawie matematycznych wzorców.

Czy AI myśli logicznie? Fakty kontra mity

Nie brakuje opinii, że argumentacja AI jest logiczna i nieomylna. W rzeczywistości sytuacja jest bardziej skomplikowana:

- AI konstruuje argumenty na podstawie statystycznych prawidłowości, nie własnej logiki.

- Modele często wykrywają sprzeczności, ale nie zawsze potrafią je poprawnie wyjaśnić.

- Chatgpt bywa ślepy na kontekst kulturowy i emocjonalny, przez co może generować argumenty nieadekwatne lub wręcz obraźliwe.

Owszem, system potrafi wykrywać błędy formalne czy nielogiczności w wypowiedzi, ale nie jest w stanie całkowicie zastąpić ludzkiego myślenia krytycznego. Jak pokazują raporty AIMarketing, 2024, AI często powiela istniejące błędy logiczne obecne w danych treningowych, przez co nie zawsze wykryje manipulację czy fałsz. Warto zatem traktować czatgpt argumentację jako narzędzie wsparcia, a nie nieomylny autorytet.

AI kontra człowiek – kto lepiej argumentuje?

Test: debata AI vs. człowiek na żywo

W jednym z najgłośniejszych eksperymentów przeprowadzonych w polskich uczelniach w 2024 roku, porównano skuteczność argumentowania przez AI i studentów. W ramach testu uczestnicy, zarówno ludzie jak i AI, prezentowali argumenty za i przeciw wybranym kwestiom społecznym. Wyniki były zaskakujące:

| Kryterium oceny | AI (średnia ocena) | Człowiek (średnia ocena) | Komentarz |

|---|---|---|---|

| Logika i spójność | 4,3/5 | 4,1/5 | AI dominuje w strukturze logicznej |

| Kreatywność argumentów | 3,2/5 | 4,5/5 | Człowiek wygrywa |

| Zrozumienie emocji | 2,8/5 | 4,7/5 | AI ma poważne braki |

| Wykrywanie fałszu | 3,7/5 | 4,2/5 | AI poprawny, ale czasem podatny na manipulację |

Tabela 2: Wyniki debaty AI vs. człowiek – eksperyment na polskich uczelniach, 2024 r. Źródło: Opracowanie własne na podstawie danych Human360, 2024 i wywiadów eksperckich

Analiza pokazuje, że AI radzi sobie świetnie z argumentami logicznymi, ale wciąż odstaje, jeśli chodzi o kreatywność, empatię i zrozumienie niuansów społecznych.

Gdzie AI wygrywa, a gdzie przegrywa

Najważniejsze przewagi i słabości AI w argumentacji:

- Szybkość i dostęp do informacji: AI generuje odpowiedzi i argumenty niemal natychmiast i na dowolny temat.

- Logiczna spójność: Modele językowe niemal bezbłędnie budują logiczne struktury wypowiedzi.

- Brak emocji: AI nie jest podatna na stres, co w teorii powinno ułatwiać chłodną argumentację.

- Brak kreatywności: AI nie tworzy oryginalnych lub zaskakujących argumentów.

- Ograniczone zrozumienie kontekstu: AI często nie rozumie aluzji, żartu czy kontekstu kulturowego.

W praktyce, AI doskonale sprawdza się jako narzędzie wsparcia dla osób, które chcą ustrukturyzować swoje myśli, ale nie powinna być traktowana jako wyrocznia. Najlepsze rezultaty osiąga się, łącząc jej przewagi z ludzką kreatywnością i wrażliwością.

Czynniki, które wpływają na jakość argumentacji AI

Jakość argumentacji AI zależy od kilku kluczowych czynników:

Im bardziej zróżnicowane i aktualne dane, tym lepsza i bardziej wszechstronna argumentacja.

Jasno sformułowane pytanie skutkuje bardziej precyzyjnymi i logicznymi argumentami.

AI bazuje na danych, które w pewnym momencie zostały zamrożone – może nie znać najnowszych faktów czy wydarzeń.

Jak podkreślają analizy Antyweb, 2023, AI nieustannie się rozwija, ale jej skuteczność w argumentacji jest zawsze ograniczona przez jakość dostępnych informacji i umiejętności użytkownika w zadawaniu pytań.

Największe mity o argumentacji AI – rozbijamy bańki

AI zawsze mówi prawdę? Błędne założenia

Mit o nieomylności AI jest jednym z najgroźniejszych współczesnych błędów poznawczych. Oto najważniejsze fałszywe przekonania:

- AI nie kłamie – w rzeczywistości modele mogą generować nieprawdziwe informacje (halucynacje).

- Argumenty AI są zawsze neutralne – algorytmy powielają uprzedzenia obecne w danych treningowych.

- AI rozpoznaje kontekst kulturowy – systemy często nie rozumieją niuansów, ironii, czy lokalnych odniesień.

Najnowsze raporty Bankier.pl, 2024 udowadniają, że chatgpt potrafi kłamać – zwłaszcza pod presją wygenerowania „oczekiwanej” odpowiedzi. W efekcie użytkownik nieświadomie może powielać błędne lub zmanipulowane treści.

Czy AI potrafi manipulować rozmową?

Temat manipulacji przez AI budzi emocje i kontrowersje. Chociaż system nie posiada własnej woli, mechanizmy argumentacyjne mogą być wykorzystywane do tworzenia przekonujących, a nawet zmanipulowanych komunikatów.

"AI generuje teksty tak przekonujące, że trudno odróżnić je od wypowiedzi człowieka – to otwiera furtkę do nadużyć, phishingu i dezinformacji." — Dr. Marek Chlebus, ekspert ds. bezpieczeństwa cyfrowego, AIMarketing, 2024

Ryzyko? AI w rękach nieuczciwych użytkowników staje się potężnym narzędziem perswazji nie tylko w marketingu, ale i w propagandzie czy cyberprzestępczości.

Czatgpt i iluzja autorytetu – na co uważać?

Jednym z największych zagrożeń jest iluzja autorytetu AI. Wielu użytkowników bezkrytycznie przyjmuje generowane argumenty jako „pewne”, zapominając, że system nie rozumie świata w ludzkim sensie.

Argumenty AI często brzmią bardzo profesjonalnie – to efekt zaawansowanego modelowania języka. Jednak brak rzeczywistego zrozumienia powoduje, że AI powiela błędy logiczne lub moralne, które znalazły się w danych treningowych. Zdarza się, że AI prezentuje fałsz w taki sposób, że nawet ekspert może mieć trudność z wyłapaniem nieścisłości.

- AI nie rozpoznaje fałszywych informacji, jeśli są powielane w bazie treningowej.

- System nie rozumie wartości etycznych i społecznych poza tym, co „wyczyta” w dostępnych danych.

- AI potrafi generować argumenty sprzeczne ze sobą, jeśli prompt zawiera niejednoznaczności.

Warto więc każdorazowo weryfikować argumenty z użyciem niezależnych źródeł i traktować AI wyłącznie jako wsparcie, a nie wyrocznię.

Praktyczne zastosowania chatgpt argumentacji w życiu codziennym

AI w negocjacjach i rozwiązywaniu konfliktów

Czatgpt argumentacja znajduje coraz więcej zastosowań w codziennych sporach i negocjacjach. Systemy AI pomagają układać propozycje kompromisu, wskazywać logiczne luki w wypowiedziach oraz sugerować alternatywne rozwiązania.

Dzięki temu nawet osoby mniej pewne siebie mogą skuteczniej bronić swoich stanowisk. Jak zauważa Antyweb, 2023, „AI wprowadza nową jakość do codziennych mediacji – pozwala spojrzeć na konflikt z dystansem, uporządkować emocje i wypracować argumentację opartą na faktach”. To jednak narzędzie, które wymaga umiejętnego i odpowiedzialnego użycia.

Warto bowiem pamiętać, że AI nie rozwiąże konfliktu za nas – może być jedynie wsparciem w logicznym „rozbrojeniu” sporu.

Jak wykorzystać czatgpt do nauki argumentacji?

Chatgpt argumentacja to nie tylko narzędzie, ale i świetny sposób na samodoskonalenie. Oto sprawdzona sekwencja wykorzystania AI do nauki argumentowania:

- Symulacja debaty: Zadaj AI kontrowersyjny temat i poproś o argumenty „za” i „przeciw”, analizując ich strukturę.

- Weryfikacja własnych wypowiedzi: Poproś AI o ocenę Twoich argumentów pod kątem logiki i spójności.

- Uczenie się na błędach: Zapytaj AI o potencjalne luki logiczne i poproś o ich wyjaśnienie.

- Tłumaczenie i adaptacja: Skorzystaj z funkcji tłumaczenia argumentów na różne języki, by testować ich uniwersalność.

- Ćwiczenia z manipulacją: Przeanalizuj, jak AI generuje fałszywe lub zmanipulowane argumenty, aby nauczyć się je rozpoznawać w praktyce.

Takie wykorzystanie AI pozwala nie tylko lepiej argumentować, ale także uczy krytycznego myślenia i dystansu wobec narzędzi cyfrowych.

Nieoczywiste korzyści – czego nie mówią eksperci

Wbrew pozorom, korzyści z używania chatgpt argumentacji nie kończą się na poprawie efektywności w pracy czy nauce.

- Wsparcie w radzeniu sobie ze stresem – AI pomaga uporządkować myśli i przygotować się do trudnych rozmów.

- Szybsze przygotowanie argumentów – oszczędność czasu, zwłaszcza w sytuacjach nagłych (np. nieplanowana prezentacja).

- Rozwój umiejętności komunikacyjnych – regularne ćwiczenia z AI poprawiają płynność wypowiedzi i argumentacji.

- Motywacja do samodzielnego pogłębiania wiedzy – AI sugeruje, gdzie szukać rzetelnych źródeł i jak je wykorzystać.

- Ułatwienie debaty w językach obcych – funkcje tłumaczenia pozwalają ćwiczyć argumentację międzynarodowo.

Nieoczywiste? Tak, ale poparte praktyką tysięcy użytkowników korzystających z czatgpt także poza oficjalnym kontekstem edukacyjnym.

Ciemna strona AI: ryzyka i kontrowersje wokół argumentacji

Echo chambers i potwierdzanie własnych przekonań

Jednym z największych zagrożeń związanych z AI argumentacyjną jest wzmacnianie tzw. „baniek informacyjnych”. Gdy użytkownik zadaje pytania z określoną tezą, AI często dostosowuje argumenty do oczekiwań, wzmacniając już posiadane przekonania.

To zjawisko może prowadzić do radykalizacji opinii i zamknięcia na alternatywne punkty widzenia. W praktyce, zamiast rozwijać sztukę debaty, AI bywa narzędziem utwierdzania użytkownika w przekonaniu o własnej racji.

Jak podkreśla AIMarketing, 2024, konieczna jest edukacja użytkowników w zakresie świadomego korzystania z AI – system nie powinien być jedynym źródłem wiedzy i argumentacji.

Manipulacje i dezinformacja – czy AI jest zagrożeniem?

Nie sposób pominąć rosnącej fali nadużyć AI w generowaniu argumentów zmanipulowanych lub wręcz fałszywych. Oto główne obszary ryzyka:

- Automatyczne generowanie wiadomości phishingowych, podszywających się pod autorytety.

- Tworzenie przekonujących argumentów na poparcie dezinformacji (fake news).

- Wspieranie kampanii propagandowych poprzez masowe generowanie jednostronnych treści.

- Ułatwianie plagiatu i nieuczciwych praktyk w edukacji.

"ChatGPT potrafi nie tylko logicznie argumentować, ale i… kłamać pod presją oczekiwań użytkownika. To realne zagrożenie dla bezpieczeństwa informacyjnego." — Raport Bankier.pl, 2024

W obliczu powyższych faktów kluczowe staje się budowanie świadomości i odpowiedzialności w korzystaniu z AI – zarówno przez użytkowników indywidualnych, jak i instytucje.

Odpowiedzialność za decyzje podjęte na podstawie AI

Kto ponosi odpowiedzialność, jeśli decyzja podjęta na podstawie argumentacji AI okaże się błędna lub szkodliwa? Problem odpowiedzialności prawnej i etycznej staje się coraz bardziej palący, zwłaszcza w kontekście edukacji i biznesu.

| Sytuacja | Odpowiedzialność AI | Odpowiedzialność użytkownika | Komentarz |

|---|---|---|---|

| Praca zaliczeniowa napisana z AI | brak | pełna | Ryzyko plagiatu |

| Decyzja biznesowa oparta na AI | brak | pełna | Użytkownik powinien weryfikować |

| Publikacja w mediach | brak | współdzielona | Konieczność podania źródeł |

| Porada przy konflikcie | brak | pełna | AI służy jedynie jako wsparcie |

Tabela 3: Odpowiedzialność za decyzje podjęte na podstawie AI. Źródło: Opracowanie własne na podstawie analiz AIMarketing, 2024

Odpowiedzialność zawsze spoczywa na człowieku – AI jest tylko narzędziem, a nie samodzielnym decydentem. To zasada, którą warto powtarzać przy każdej okazji.

Jak wycisnąć maksimum z chatgpt argumentacji – przewodnik użytkownika

Checklista: jak ocenić jakość argumentu AI

Umiejętne korzystanie z AI wymaga krytycznego podejścia. Oto lista kontrolna, która pozwoli ocenić, czy wygenerowany argument jest wartościowy:

- Sprawdź źródła: Czy argument opiera się na wiarygodnych, zweryfikowanych danych?

- Weryfikuj logikę: Czy wypowiedź jest spójna i pozbawiona błędów logicznych?

- Unikaj powtarzalności: Czy tekst nie powiela ogólników lub utartych schematów?

- Weryfikuj aktualność: Czy dane są świeże, a argument odnosi się do obecnych realiów?

- Testuj na różnych promptach: Czy zmiana polecenia nie powoduje sprzecznych odpowiedzi?

Stosując powyższą check-listę, minimalizujesz ryzyko powielenia błędów lub padnięcia ofiarą iluzji autorytetu AI.

Najczęstsze błędy użytkowników – jak ich unikać

Największe pułapki, w które wpadają użytkownicy korzystający z chatgpt argumentacji:

- Bezrefleksyjne akceptowanie odpowiedzi AI, bez ich weryfikowania.

- Używanie nieprecyzyjnych promptów, co skutkuje niejasnymi lub błędnymi argumentami.

- Wykorzystywanie AI do pisania prac naukowych – ryzyko plagiatu i utraty wiarygodności.

- Poleganie wyłącznie na AI przy podejmowaniu ważnych decyzji.

- Brak świadomości ograniczeń modelu językowego.

Unikanie powyższych błędów wymaga nie tylko wiedzy technicznej, ale też pokory i dystansu wobec narzędzi cyfrowych.

Czatgpt w praktyce – case study z Polski

W jednym z polskich liceów w Warszawie, nauczyciel poprosił uczniów o napisanie eseju na temat „Czy AI może zastąpić człowieka w sztuce argumentacji?”. Część uczniów wykorzystała chatgpt do przygotowania swoich tekstów. Efekt? Prace AI wyróżniały się logiczną spójnością, ale brakowało im indywidualnego stylu i głębszych refleksji.

W rozmowie z uczniami okazało się, że większość z nich użyła AI do szybkiego zebrania argumentów, a potem wzbogaciła je własnymi przykładami i emocjami. To połączenie okazało się najskuteczniejsze.

"AI dało mi ramy, ale to ja nadałem pracy sens i autentyczność. Bez własnego wkładu tekst byłby tylko matematyczną układanką." — Anonimowy uczeń, Warszawa

Wnioski? Chatgpt argumentacja działa najlepiej wtedy, gdy jest uzupełnieniem ludzkiej kreatywności i doświadczenia.

Przyszłość argumentacji AI – trendwatching 2025

Nadchodzące innowacje w AI argumentacyjnej

W 2024 roku obserwujemy wyraźny wzrost zainteresowania innowacjami w zakresie AI argumentacyjnej. Rozwijane są narzędzia umożliwiające jeszcze bardziej spersonalizowaną i kontekstową analizę wypowiedzi.

Obecnie testowane rozwiązania obejmują:

- Analizę emocji i tonu wypowiedzi w argumentacji AI.

- Lepsze wykrywanie manipulacji i błędów logicznych.

- Poszerzanie baz danych o źródła lokalne i specjalistyczne.

- Narzędzia do dynamicznej adaptacji argumentacji w czasie rzeczywistym.

- Automatyczną analizę skuteczności argumentów (feedback dla użytkownika).

Rozwój tych technologii to szansa, ale i wyzwanie – kluczowe staje się zachowanie kontroli i przejrzystości w procesach decyzyjnych.

Polska scena AI – czy jesteśmy gotowi?

W Polsce scena AI rozwija się dynamicznie, a coraz więcej firm i instytucji testuje narzędzia do argumentacji wspomaganej przez AI. Zainteresowanie dotyczy zarówno sektora edukacji, jak i biznesu.

| Obszar zastosowania | Wdrażanie AI (%) | Komentarz |

|---|---|---|

| Edukacja | 31 | Największy potencjał widzą szkoły wyższe |

| Korporacje i biznes | 27 | AI wspiera negocjacje i prezentacje |

| Administracja publiczna | 12 | Ostrożne wdrożenia pilotażowe |

| Media i komunikacja | 19 | Testy narzędzi do argumentacji i moderacji dyskusji |

Tabela 4: Wdrażanie AI argumentacyjnej w Polsce, 2024 r. Źródło: Opracowanie własne na podstawie danych branżowych.

Polska scena AI nie odstaje od światowych trendów, ale wyzwania związane z edukacją i świadomością użytkowników pozostają aktualne.

Rola czat.ai i innych chatbotów w przyszłości dyskusji

Czat.ai oraz inne zaawansowane chatboty już teraz kształtują nowe standardy debaty i argumentacji. Ich rola nie ogranicza się do udzielania odpowiedzi – coraz częściej stają się moderatorami, doradcami oraz narzędziami do ćwiczeń z argumentacji na różnych poziomach zaawansowania.

Dzięki personalizacji i możliwości uczenia się na podstawie interakcji, chatboty wspierają użytkowników w rozwijaniu umiejętności komunikacyjnych i krytycznego myślenia. Co ważne, czat.ai zyskuje uznanie za bezpieczeństwo danych i przejrzystość działania, czego brakuje niektórym globalnym gigantom.

Podsumowując, chatboty AI nie wyręczą człowieka w myśleniu, ale mogą być katalizatorem rozwoju kompetencji argumentacyjnych.

Podsumowanie: co warto zapamiętać o chatgpt argumentacji?

5 kluczowych wniosków dla użytkownika

Chatgpt argumentacja to potężne narzędzie, ale wymaga świadomego i krytycznego podejścia. Najważniejsze wnioski:

- AI to wsparcie, nie autorytet: Systemy pomagają strukturze wypowiedzi, ale nie zastępują własnego myślenia.

- Weryfikuj dane: Zawsze sprawdzaj źródła i nie ufaj bezkrytycznie generowanym argumentom.

- Zachowaj dystans: Argumenty AI bywają logiczne, ale często brakuje im kreatywności i empatii.

- Wykorzystuj AI do nauki: Symulacje debat i ćwiczenia z AI rozwijają umiejętności argumentacji.

- Chroń się przed manipulacją: Pamiętaj o ryzykach – od dezinformacji po plagiat.

Stosując się do powyższych zasad, możesz wycisnąć maksimum korzyści z chatgpt argumentacji bez popadania w pułapki cyfrowej iluzji.

Czy AI przekona cię do zmiany zdania?

Na to pytanie nie ma jednoznacznej odpowiedzi. AI potrafi być bezlitośnie logiczna, ale czy jest w stanie realnie przekonać człowieka do zmiany zdania? Wszystko zależy od naszej świadomości i krytycyzmu.

"AI daje argumenty, ale to my decydujemy, które z nich przyjmiemy za własne." — Opracowanie własne na podstawie wywiadów z użytkownikami czatgpt

Na koniec liczy się nie to, co powie AI, ale jak my – ludzie – zinterpretujemy i wykorzystamy jej głos w codziennej debacie.

Źródła

Źródła cytowane w tym artykule

- Antyweb(antyweb.pl)

- AIMarketing(aimarketing.pl)

- Bankier.pl(bankier.pl)

- Human360(human360.life)

- AI Debate Battle(poe.com)

- University of Mississippi(olemiss.edu)

- KU News(news.ku.edu)

- Wszystko co najważniejsze(wszystkoconajwazniejsze.pl)

- THINKTANK(think-tank.pl)

- Android.com.pl(android.com.pl)

- Kreatywna.pl(kreatywna.pl)

- Prompti(prompti.pl)

- RedSEO(redseo.pl)

- Naukowy Bełkot(naukowybelkot.pl)

- WP Tech(tech.wp.pl)

- InteligencjaSztuczna.pl(inteligencjasztuczna.pl)

- Instalki(instalki.pl)

- Nieruchomosci-online.pl(nieruchomosci-online.pl)

- Practical Tips(practical-tips.com)

- Kajabobrowicz(kajabobrowicz.pl)

- PrompterAI(prompterai.pl)

- UMCS(journals.umcs.pl)

- AstrowebDesign(astrowebdesign.pl)

- Jak się uczyć(jaksieuczyc.pl)

- BeInCrypto(pl.beincrypto.com)

- Forsal(forsal.pl)

- ChatGPT4.pl(chatgpt4.pl)

- AIOAI(aioai.pl)

- Poradnik Inżyniera(poradnikinzyniera.pl)

Czas na inteligentne wsparcie

Zacznij rozmawiać z chatbotami już teraz

Więcej artykułów

Odkryj więcej tematów od czat.ai - Polski chat GPT: Chatboty AI wspierające codzienne życie

ChatGPT aranżacje muzyczne: przewaga, którą budujesz dziś

Chatgpt aranżacje muzyczne mogą cię zaskoczyć: odkryj, jak AI burzy branżę, kto na tym wygrywa i jak nie zostać w tyle. Sprawdź, co musisz wiedzieć.

ChatGPT app w Polsce 2026: realne zyski, realne ryzyko

Chatgpt app – odkryj, jak naprawdę zmienia twoje życie. Fakty, mity i zaskakujące skutki. Przeczytaj zanim pobierzesz. Sprawdź, co ukrywają eksperci.

ChatGPT aplikacja w 2026: kiedy pomaga, a kiedy szkodzi

Chatboty przeszły długą drogę od prostych skryptów odpowiadających na banały, po rozbudowane aplikacje zasilane przez zaawansowane modele językowe. Jeszcze w 20

Chatgpt api łączenie w 2026: kiedy integracja się opłaca, a kiedy szkodzi

Chatgpt api łączenie – Odkryj szokujące fakty, błędy których nikt nie opisuje i przewrotne zalety integracji AI. Poznaj całą prawdę i praktyczne wskazówki już teraz!

ChatGPT API używanie mądrze: zysk, ryzyko i granice kontroli

Chatgpt api używanie – Poznaj ukryte możliwości, pułapki i nieoczywiste zastosowania. Zaskakujące case’y, ostrzeżenia i praktyczne rady. Sprawdź, zanim zaczniesz!

ChatGPT API ceny w 2026 – realny koszt dla polskich firm

Odkryj całą prawdę o kosztach, pułapkach i realnych stawkach w 2026. Sprawdź, zanim przepalisz budżet – porównania, checklisty, case’y.

ChatGPT API w Polsce 2026 – zysk czy kosztowna iluzja?

Odkryj nowe zastosowania, kontrowersje i realne koszty. Poznaj prawdziwe historie i ukryte pułapki. Zanim zainwestujesz – przeczytaj!

Chatgpt android w Polsce: realne zyski, ukryte koszty, bezpieczne użycie

Chatgpt android – Odkryj, jak AI na Twoim telefonie zmienia codzienność Polaków. Praktyczne porady, twarde dane i ostrzeżenia. Sprawdź, zanim pobierzesz!

ChatGPT analizy rynku w Polsce: realne zyski kontra ryzyko

Poznaj fakty, obal mity i odkryj, jak AI zmienia reguły gry na polskim rynku. Nie daj się zaskoczyć – sprawdź, co naprawdę działa!

ChatGPT analiza SWOT bez złudzeń: kiedy ufać AI w strategii

Odkryj bezlitosne fakty, ukryte korzyści i pułapki. Praktyczny przewodnik, przykłady, eksperckie opinie. Sprawdź, zanim zaufasz AI!

ChatGPT analiza przyczyn czy jej symulacja? Rzeczywiste granice AI

Odkryj, jak AI naprawdę rozpoznaje motywy i błędy. Przekonaj się, co ukrywają chatboty. Czy jesteś gotowy poznać całą prawdę?

ChatGPT alternatywy darmowe, które naprawdę działają w 2026

Chatgpt alternatywy darmowe – odkryj świeże, darmowe AI, które naprawdę działają. Porównania, mity i praktyczne wskazówki. Sprawdź, co tracisz!