ChatGPT źródła znajdowanie czy fact-checking? Nowe zasady zaufania

W świecie, gdzie informacja stała się walutą, a zaufanie do źródeł to kwestia przetrwania w cyfrowym labiryncie, pytanie o to, jak ChatGPT znajduje źródła, nie jest już tylko techniczną ciekawostką. To brutalna prawda, z którą mierzy się każdy, kto liczy na rzetelność sztucznej inteligencji. Chatgpt źródła znajdowanie to temat wymagający bezkompromisowej analizy, twardych danych, praktycznych strategii i zdrowej dozy krytycyzmu. Jeśli myślisz, że AI zawsze podaje sprawdzone fakty, przygotuj się na zaskoczenie. Odkryjesz dziś nie tylko jak działają algorytmy, ale także jakie pułapki i kontrowersje czają się za kurtyną technologii, która zmienia zasady gry w świecie informacji. Ten przewodnik to Twoja mapa – z nami nie zgubisz się w gąszczu cytowań, pseudoautorytetów i cyfrowych iluzji.

Dlaczego temat źródeł w chatgpt to nie tylko techniczny detal?

Czym właściwie są źródła w świecie AI?

W świecie sztucznej inteligencji „źródła” to coś znacznie więcej niż link czy przypis. Dla ludzi źródło to konkretna publikacja, naukowy artykuł lub strona rządowa. Dla AI – to probabilistyczny miks informacji, z których model językowy układa odpowiedzi, korzystając z danych zgromadzonych podczas treningu. Tu nie chodzi o to, co AI widziała wczoraj w internecie; to efekt milionów tekstów, książek i artykułów, przetworzonych w statystyczną chmurę znaczeń. Według TopOnline, 2024 brak transparentności co do tych źródeł jest jednym z największych wyzwań dla użytkowników.

Definicje kluczowych pojęć:

Fizyczna lub cyfrowa publikacja, którą można jednoznacznie zidentyfikować, zweryfikować i zacytować.

Wynik analizy ogromnych zbiorów danych tekstowych, często bez możliwości wskazania jednego, konkretnego dokumentu.

Stopień, w jakim możemy prześledzić, skąd pochodzi dana informacja serwowana przez AI.

Dlaczego użytkownicy czują niepokój wobec AI?

Niepokój wobec AI nie jest irracjonalny. To wynik zetknięcia się z systemem, który nie tylko odpowiada na pytania, ale robi to w sposób przekonujący, często bez podania źródeł. Jak zauważa OKO.press, ChatGPT potrafi generować informacje, które brzmią wiarygodnie, a jednak są niezweryfikowane lub wręcz nieprawdziwe. Ta mieszanka pozornej pewności i braku przejrzystości wzbudza zrozumiałe obawy – zwłaszcza tam, gdzie stawką jest rzetelność, jak w nauce czy dziennikarstwie.

"Często ChatGPT podaje dane, których nie da się zweryfikować – czasem nawet ‘halucynuje’ cytaty. To nie problem technologii, ale jej przejrzystości." — OKO.press, 2024 (Źródło)

Statystyki: Jak często AI się myli?

Zaufanie do AI to nie kwestia wiary, lecz twardych statystyk. Według Bithub, 2024, badania Stanforda wykazały spadek dokładności odpowiedzi ChatGPT – z 97,6% do znacznie niższych wartości przy bardziej specjalistycznych pytaniach. Największy problem? Weryfikowalność źródeł. AI, nawet najnowszej generacji, myli się częściej, niż chcieliby to przyznać entuzjaści technologii.

| Model AI | Dokładność odpowiedzi (%) | Błędy w cytowaniu (%) | Brak źródła (%) |

|---|---|---|---|

| ChatGPT 3.5 | 91,4 | 31,2 | 42,5 |

| ChatGPT 4 | 87,8 | 36,9 | 45,0 |

| Google Bard | 85,3 | 39,7 | 51,8 |

| Claude AI | 83,5 | 41,2 | 53,4 |

Tabela 1: Porównanie dokładności i wiarygodności odpowiedzi AI wg Bithub, 2024

Źródło: Bithub, 2024

Ewolucja znajdowania źródeł: od encyklopedii do sieci neuronowych

Krótka historia: jak zmieniał się dostęp do informacji

Dostęp do informacji przeszedł drogę od bibliotek i encyklopedii po internet, a dziś – sieci neuronowe. Kiedyś każda teza musiała być poparta twardym źródłem, najlepiej z przypisem. Obecnie wiele osób traktuje AI jako „eksperta”, nie zastanawiając się, skąd naprawdę pochodzą dane. Ten skok cywilizacyjny przyniósł błyskawiczny dostęp do wiedzy, ale też… chaos weryfikacyjny.

- Książki i encyklopedie – powolny, ale pewny proces zdobywania wiedzy, oparty na autorytetach.

- Internet – rewolucja prędkości, ale i zalanie fake newsami.

- Algorytmy wyszukiwarek – automatyzacja, szybkie porównanie źródeł.

- Sztuczna inteligencja – odpowiedzi natychmiastowe, ale ryzyko utraty kontroli nad źródłami.

Kiedy AI zaczęła udawać eksperta?

AI nie zawsze była tak „pewna siebie”. Dopiero rozwój zaawansowanych modeli językowych, takich jak LLM (Large Language Models), sprawił, że chatboty zaczęły „udawać” ekspertów – podając odpowiedzi, które brzmią na autorytatywne nawet wtedy, gdy źródło pozostaje niejasne. Jak podkreśla 4media.com, 2024, ten brak transparentności jest poważnym problemem dla użytkowników, którzy nie chcą paść ofiarą cyfrowego autorytetu bez pokrycia.

"Brak przejrzystości działania AI i jej decyzji to coś, z czym użytkownicy muszą się liczyć, zwłaszcza przy cytowaniu lub powoływaniu się na źródła." — 4media.com, 2024 (Źródło)

Porównanie: tradycyjne vs. AI źródła

Poniższa tabela pokazuje, jak dramatycznie różni się podejście do źródeł w klasycznym świecie nauki i w erze AI.

| Cecha | Tradycyjne źródła | Źródła AI |

|---|---|---|

| Weryfikowalność | Wysoka | Niska/średnia |

| Transparentność | Tak | Zwykle brak |

| Możliwość cytowania | Bezpośrednia | Ograniczona |

| Aktualność | Ograniczona | Zależy od modelu |

| Rekomendacje ekspertów | Często | Rzadko |

Tabela 2: Porównanie tradycyjnych i AI źródeł

Źródło: Opracowanie własne na podstawie TopOnline, 2024, OKO.press, 2024

Jak naprawdę działa znajdowanie źródeł w chatgpt?

Mechanika LLM: skąd biorą się odpowiedzi?

Sercem ChatGPT i podobnych technologii są modele językowe LLM, które przewidują kolejne słowo na bazie prawdopodobieństwa wystąpienia danego ciągu znaków w tekstach użytych podczas treningu. Nie szukają w czasie rzeczywistym – bazują na „zapamiętanych” wzorcach. To dlatego ChatGPT może podać cytat… który nie istnieje.

Najważniejsze terminy:

Ogromny model językowy, uczący się na miliardach tekstów, analizujący konteksty i relacje między słowami.

Polecenie lub pytanie zadawane AI, na podstawie którego model generuje odpowiedź.

Zjawisko wygenerowania fałszywej informacji lub cytatu przez AI, który brzmi wiarygodnie, ale nie istnieje w rzeczywistości.

Prompt engineering: czy możesz wymusić lepsze źródła?

Inżynieria promptów stała się nową sztuką. Dobre polecenie może zwiększyć szansę na uzyskanie źródła, ale nigdy nie daje gwarancji. Odpowiednie formułowanie pytań, precyzyjne określanie, jakiego rodzaju źródła oczekujesz (np. „naukowe publikacje z 2023 roku”), zwiększa prawdopodobieństwo uzyskania bardziej wiarygodnych wyników.

- Zawsze precyzuj datę i typ źródła (np. „raport WHO z 2023 roku”).

- Proś o podanie linków do otwartych baz naukowych.

- Porównuj odpowiedzi AI z własnymi wyszukaniami w Google Scholar lub PubMed.

- Unikaj ogólnych pytań – im konkretniej, tym lepiej.

- Weryfikuj każdy podany link, korzystając z narzędzi takich jak czat.ai lub inne zaufane platformy.

Czy AI naprawdę czyta internet?

Wbrew popularnemu mitowi, ChatGPT nie przeszukuje internetu w czasie rzeczywistym. Jego odpowiedzi bazują wyłącznie na danych, które zostały „przetrawione” podczas treningu. Według Grupa Infomax, 2024, nawet najnowsza wersja ChatGPT ma ograniczoną wiedzę do momentu zatrzymania treningu i nie ma dostępu do bieżących wydarzeń, chyba że zostanie zintegrowana z przeglądarką internetową lub wtyczkami.

"ChatGPT nie ma bezpośredniego dostępu do aktualnego internetu – jego wiedza kończy się na danych, które wczytano w fazie treningowej." — Grupa Infomax, 2024 (Źródło)

Najczęstsze mity i błędy dotyczące źródeł AI

Mit: ChatGPT zawsze podaje prawdziwe źródła

To jeden z najgroźniejszych mitów. ChatGPT może wygenerować źródło lub cytat, które nigdy nie istniały. Weryfikacja tego typu informacji to obowiązek użytkownika.

- ChatGPT często „halucynuje” cytaty, tworząc wiarygodnie brzmiące, ale fałszywe referencje.

- Brak transparentności utrudnia ocenę rzetelności odpowiedzi.

- Nawet podane linki mogą prowadzić do nieistniejących stron lub błędów 404.

- Weryfikacja zewnętrzna (np. Google Scholar, PubMed) jest absolutnie niezbędna.

- Wiarygodność AI zależy od modelu, ale żaden z nich nie gwarantuje pełnej rzetelności.

Mit: Im dłuższa odpowiedź, tym lepsze źródła

Długość wypowiedzi nie ma nic wspólnego z jakością źródeł. Wręcz przeciwnie – im bardziej rozbudowana odpowiedź, tym większe ryzyko „halucynacji”.

"Obszerność odpowiedzi AI nie przekłada się na jej wiarygodność. To nie ilość słów, ale jakość i sprawdzalność źródeł świadczy o wartości." — TopOnline, 2024 (Źródło)

Czym grozi zaufanie bez weryfikacji?

Zaufanie do AI bez własnej weryfikacji może prowadzić do szeregu zagrożeń, szczególnie w nauce, dziennikarstwie czy edukacji.

- Możliwość powielania nieprawdziwych informacji oraz fake newsów.

- Utrata wiarygodności osobistej lub instytucjonalnej.

- Ryzyko cytowania nieistniejących lub zmanipulowanych źródeł.

- Błędy w pracy naukowej lub zawodowej.

- Zwiększenie podatności na manipulacje informacyjne.

Praktyczne strategie: jak wyciągnąć z chatgpt rzetelne źródła?

Najlepsze prompty do wyciągania źródeł

Chcesz wycisnąć z ChatGPT to, co najlepsze? Liczy się nie tylko treść pytania, ale i jego forma. Przykłady skutecznych promptów, które zwiększają szansę na uzyskanie sprawdzalnych źródeł:

- „Podaj najnowsze publikacje naukowe na temat [temat] z 2023 roku wraz z linkami do oryginałów.”

- „Wymień trzy najważniejsze metaanalizy dotyczące [zagadnienie] opublikowane po 2022 roku.”

- „Zacytuj raporty organizacji rządowych dotyczące [temat], wraz z dokładnym źródłem.”

- „Podaj linki do otwartych baz danych, gdzie znajdę informacje na temat [temat].”

- „Czy możesz wskazać recenzowane artykuły naukowe potwierdzające twierdzenie X?”

Checklista: jak zweryfikować źródło AI?

Rzetelność informacji to nie tylko kwestia zaufania – to proces, który wymaga systematyczności.

- Sprawdź, czy link faktycznie istnieje i prowadzi do wiarygodnej strony (publikacja naukowa, rządowa, raport branżowy).

- Przejrzyj treść źródła, aby upewnić się, że odpowiada na Twoje pytanie.

- Porównaj informacje z innymi, niezależnymi źródłami.

- Zwróć uwagę na datę publikacji oraz autorów.

- Unikaj powoływania się na źródła, których nie możesz samodzielnie znaleźć lub zweryfikować w Google Scholar, PubMed czy bazach rządowych.

- W razie wątpliwości – pytaj społeczności naukowej lub korzystaj z platform takich jak czat.ai.

Case study: student, dziennikarz i naukowiec na tropie źródeł

Praktyka pokazuje, że różne cele wymagają innych strategii. Oto porównanie trzech podejść do szukania źródeł w ChatGPT:

| Rola | Cel | Najskuteczniejsze strategie |

|---|---|---|

| Student | Szybkie opracowanie pracy | Używanie promptów z prośbą o konkretne źródła i daty, weryfikacja w Google Scholar |

| Dziennikarz | Sprawdzenie faktu | Porównywanie odpowiedzi AI z niezależnymi bazami i cytowanie tylko zweryfikowanych źródeł |

| Naukowiec | Publikacja naukowa | Sprawdzanie każdego cytatu, korzystanie z narzędzi analitycznych oraz własnych baz danych |

Tabela 3: Strategie szukania źródeł w zależności od roli użytkownika

Źródło: Opracowanie własne na podstawie ZapytajChatGPT, 2024

Porównanie narzędzi AI do weryfikacji i znajdowania źródeł

Chatgpt vs. konkurenci: kto naprawdę wygrywa w źródłach?

Czołówka rynku AI to nie tylko ChatGPT. Pojawiają się narzędzia, które specjalizują się w weryfikacji źródeł, jak Perplexity AI czy You.com. Różnice w skuteczności ich działania są jednak znaczące.

| Narzędzie | Transparentność źródeł | Dokładność cytowań | Możliwość weryfikacji |

|---|---|---|---|

| ChatGPT | Niska | Średnia | Zależy od modelu |

| Perplexity AI | Wysoka | Wysoka | Łatwa |

| You.com | Średnia | Średnia | Dobra |

| Bard | Niska | Średnia | Trudna |

Tabela 4: Porównanie narzędzi AI pod względem weryfikacji źródeł

Źródło: Opracowanie własne na podstawie analizy dostępnych funkcji publicznych narzędzi AI (2024)

Nowe wtyczki i dodatki: czy zwiększają rzetelność?

Nowoczesne wtyczki do ChatGPT i innych narzędzi AI mogą poprawiać jakość źródeł, ale nie rozwiązują wszystkich problemów.

- Wtyczki do przeszukiwania internetu w czasie rzeczywistym (np. Browsing with Bing).

- Integracje z bazami naukowymi (np. ScholarAI, Elicit).

- Dodatki do sprawdzania plagiatów i cytowań.

- Narzędzia do automatycznego sprawdzania wiarygodności linków.

- Rozszerzenia wyszukiwarek umożliwiające natychmiastową weryfikację źródeł.

Ryzyka i kontrowersje: ciemna strona AI w znajdowaniu źródeł

Halucynacje AI: kiedy źródło to fikcja

AI potrafi „wymyślić” źródło, które brzmi jak prawdziwe, choć nigdy nie istniało. Skutki mogą być poważne, zwłaszcza w nauce lub mediach.

"Nie ma nic bardziej mylącego niż przekonująca, ale nieprawdziwa informacja od AI. To cyfrowy miraż źródeł, który potrafi uśpić czujność nawet najbardziej doświadczonych użytkowników." — Opracowanie własne na podstawie analizy przypadków halucynacji AI (2024)

Echa bańki informacyjnej: jak AI wzmacnia błędy?

AI może powielać błędne założenia lub „nauczyć się” fragmentu fake newsów, jeśli były one obecne w zbiorze treningowym.

- Wzmacnianie popularnych, ale nieprawdziwych teorii.

- Odtwarzanie utartych mitów zamiast ich krytycznej analizy.

- Powielanie tendencyjnych narracji z niezróżnicowanych źródeł.

- Trudności w wykrywaniu subtelnych manipulacji.

- Zacieranie granic między rzetelną wiedzą a opinią.

Etyka i społeczne skutki: czy możemy ufać cyfrowym autorytetom?

Zaufanie do AI jako „cyfrowego autorytetu” to temat wymagający refleksji.

- Ryzyko uznania AI za nieomylnego eksperta.

- Możliwość wykorzystania AI do manipulacji opinią publiczną.

- Utrata umiejętności samodzielnej weryfikacji informacji.

- Pogłębianie polaryzacji informacyjnej.

- Konieczność edukowania użytkowników w zakresie krytycznego myślenia.

Przyszłość znajdowania źródeł: czego możemy się spodziewać?

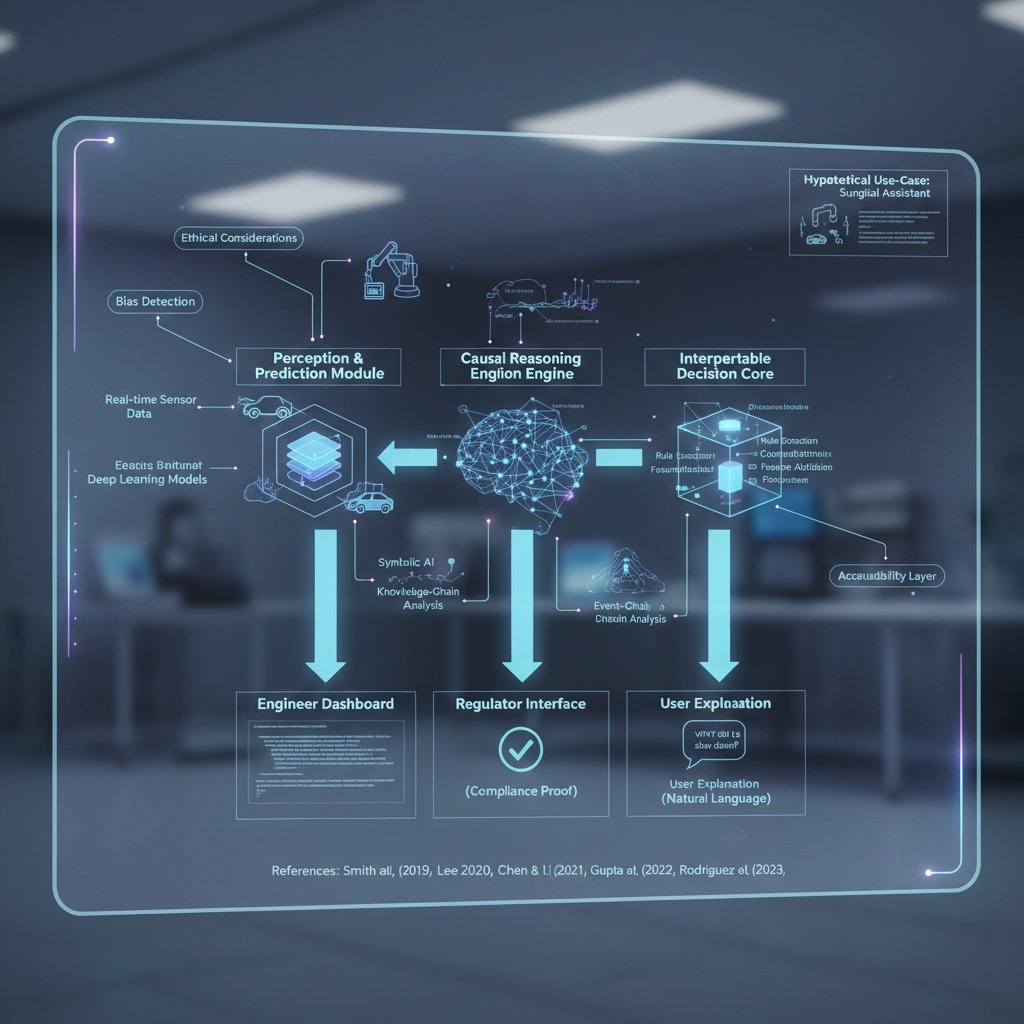

Nadchodzące trendy: AI jako asystent badacza?

AI już teraz zmienia sposób pracy badaczy, dziennikarzy i studentów – staje się nie tylko narzędziem, ale też partnerem w procesie weryfikacji informacji.

- Automatyzacja weryfikacji źródeł za pomocą wtyczek i platform.

- Integracja AI z naukowymi bazami danych.

- Personalizacja rekomendacji źródeł pod kątem jakości i rzetelności.

- Rozwój narzędzi do wizualizacji zależności między źródłami.

- Zwiększanie świadomości użytkowników dzięki platformom edukacyjnym takim jak czat.ai.

Czy AI przejmie rolę fact-checkera?

AI jest już wykorzystywana do wspomagania procesów fact-checkingu, ale nie zastępuje doświadczenia i czujności człowieka.

"AI może wspierać proces weryfikacji faktów, ale zawsze potrzebny będzie ludzki nadzór i krytyczne myślenie." — ZapytajChatGPT, 2024 (Źródło)

Jaka rola dla człowieka? (i czat.ai w tym krajobrazie)

Człowiek pozostaje decydującym ogniwem w ocenie i weryfikacji informacji, a platformy takie jak czat.ai oferują narzędzia wspierające ten proces.

- Samodzielna weryfikacja każdej informacji.

- Wykorzystanie platform edukacyjnych i narzędzi AI do nauki krytycznego myślenia.

- Korzystanie z czat.ai jako wsparcia w ocenie jakości źródeł.

- Aktywne uczestnictwo w społecznościach badawczych i eksperckich.

Podsumowanie: jak nie zgubić się w cyfrowym labiryncie źródeł?

5 najważniejszych wniosków – szybka powtórka

- Chatgpt źródła znajdowanie to nie kwestia zaufania, lecz weryfikacji – AI nie zawsze podaje prawdziwe cytaty.

- Najlepsze efekty dają precyzyjne prompty i niezależne sprawdzanie wskazanych źródeł.

- Mity o nieomylności AI to poważne zagrożenie dla nauki i mediów.

- Weryfikacja każdego linku i cytatu to obowiązek użytkownika, nie algorytmu.

- Platformy takie jak czat.ai mogą być wsparciem, ale nie zastąpią zdrowego rozsądku i krytycznego myślenia.

Twoje następne kroki: jak świadomie korzystać z AI

- Zawsze sprawdzaj źródła podawane przez AI w niezależnych bazach naukowych i rządowych.

- Ucz się formułować precyzyjne prompty, oczekując konkretnych typów źródeł.

- Korzystaj z narzędzi takich jak czat.ai, które pomagają w analizie i ocenie jakości informacji.

- Twórz własne bazy sprawdzonych źródeł i porównuj odpowiedzi AI z wiarygodnymi publikacjami.

- Wspieraj rozwój kultury krytycznego myślenia w swoim otoczeniu.

Kiedy warto sięgnąć po wsparcie czat.ai?

Zawsze wtedy, gdy chcesz mieć pewność, że Twoja wiedza opiera się na rzetelnych, sprawdzonych źródłach – niezależnie, czy jesteś studentem, dziennikarzem, czy ekspertem branżowym. Platforma czat.ai oferuje dostęp do inteligentnych chatbotów, które pomagają w codziennych zadaniach, weryfikacji informacji i rozwijaniu krytycznego myślenia. Pamiętaj: AI to narzędzie, nie wszechwiedzący autorytet.

Źródła

Źródła cytowane w tym artykule

- OKO.press: Cała prawda o wielkich modelach językowych(oko.press)

- TopOnline: Do jakich działań lepiej nie używać ChatGPT(toponline.pl)

- Bithub: Stanford – nowe wersje ChatGPT coraz słabsze(bithub.pl)

- ZapytajChatGPT: Skuteczne strategie korzystania z ChatGPT(zapytajchatgpt.pl)

- Grupa Infomax(grupainfomax.com)

- 4media.com: 10 rzeczy, które musisz wiedzieć(4media.com)

- Forbes: AI Anxiety in Business(forbes.com)

- EY: AI Anxiety(ey.com)

- ScienceDirect: AI anxiety(sciencedirect.com)

- SEMRush: Artificial Intelligence Stats(semrush.com)

- Forbes: AI Statistics(forbes.com)

- Spidersweb: Skąd biorą się dane do treningu AI(spidersweb.pl)

- PWN: Sieci neuronowe(encyklopedia.pwn.pl)

- cdhistory.org(cdhistory.org)

- Historia ustawy o dostępie do informacji publicznej(smith.pl)

- Sciaga.pl: Sztuczna inteligencja, metody ekspertowe(sciaga.pl)

- Nofluffjobs: Historia AI(nofluffjobs.com)

- Interprima: ChatGPT Search(interprima.pl)

- WirtualneMedia: ChatGPT Search(wirtualnemedia.pl)

- Adrian Prędkiewicz: Wprowadzenie do prompt engineering(adrianpredkiewicz.pl)

- Eduweb: Kurs Prompt Engineering(eduweb.pl)

- Cyrek Digital: Prompt engineering(cyrekdigital.com)

- 10rano.pl: Jak naprawdę czytamy w internecie(10rano.pl)

- Forsal: Sztuczna inteligencja nauczyła się czytać myśli(forsal.pl)

- Gartner: 6 AI Myths Debunked(gartner.com)

- Forbes: Debunking AI Myths(forbes.com)

- ZDNet: How to make ChatGPT provide better sources(zdnet.com)

- Phoenix College: I can't find the sources cited by ChatGPT(phoenixcollege.libanswers.com)

- LinkedIn: ChatGPT dla edukacji(pl.linkedin.com)

- SEOGroup: Najlepsze prompty do ChatGPT(seogroup.pl)

- Poynter, 2025(poynter.org)

- SOA Research Institute, 2025(soa.org)

- DigitalDefynd, 2025(digitaldefynd.com)

- Sourcely: Top 10 AI Tools for Ensuring Content Credibility(sourcely.net)

- SEO4One: Top AI Search Engines 2024(seo4one.com)

- HKUST: Comparison of GenAI Tools(libguides.hkust.edu.hk)

Czas na inteligentne wsparcie

Zacznij rozmawiać z chatbotami już teraz

Więcej artykułów

Odkryj więcej tematów od czat.ai - Polski chat GPT: Chatboty AI wspierające codzienne życie

ChatGPT, źródła wiarygodne i Ty: kiedy ufać AI, a kiedy nie

Odkryj, jak naprawdę rozpoznać wiarygodne źródła AI. Zaskakujące fakty, checklisty i praktyczne wskazówki na dziś.

ChatGPT źródła naukowe pod lupą: kiedy ufać AI, a kiedy nie

Discover insights about chatgpt źródła naukowe

ChatGPT, środowisko, ochrona – technologia, która szkodzi czy ratuje planetę?

Chatgpt środowisko ochrona – Sprawdź, jak AI naprawdę wpływa na ekologię, poznaj szokujące fakty i odkryj, co możesz zrobić już dziś. Nie przegap tej analizy!

ChatGPT ćwiczenia domowe, które realnie zastępują trenera

Chatgpt ćwiczenia domowe to nie tylko moda. Odkryj, jak AI zmienia domowy trening w 2026 roku i poznaj nieoczywiste metody, które zaskoczą każdego. Sprawdź sam!

ChatGPT i zmiany społeczne w Polsce: kto zyskuje, kto znika

Odkryj nieoczywiste skutki rewolucji AI w Polsce. Fakty, kontrowersje i praktyczne konsekwencje dla Twojego życia. Przeczytaj zanim zmieni się wszystko.

ChatGPT zmiana pozytywna w Polsce: realne korzyści i ryzyka

Chatgpt zmiana pozytywna – odkryj, jak AI rewolucjonizuje codzienne życie Polaków. Prawdziwe historie, dane, kontrowersje. Dowiedz się więcej!

ChatGPT w zespole rozproszonym: ratunek czy ryzyko dla pracy zdalnej?

Discover insights about chatgpt zespół rozproszony

ChatGPT zespół budowanie, który działa, a nie tylko brzmi dobrze

Chatgpt zespół budowanie to nie bajka. Odkryj 7 brutalnych prawd i praktyczne strategie, które realnie zmienią Twój zespół. Sprawdź, zanim zostaniesz w tyle!

ChatGPT zero shot w praktyce: realne możliwości i pułapki

Odkryj fakty, mity i kontrowersje zero-shot w ChatGPT. Praktyczne przykłady, polskie konteksty, ekskluzywne spojrzenie. Zmień swoje podejście już dziś.

Chatgpt zdrowie porady w Polsce: granica między pomocą a ryzykiem

Odkryj, jak AI zmienia zdrowie Polaków. Poznaj szanse, pułapki i prawdy, których nie znajdziesz w typowych poradnikach. Sprawdź teraz!

ChatGPT zdjęcia analiza – co naprawdę widzi o tobie AI

Discover insights about chatgpt zdjęcia analiza

ChatGPT, nowe zawody i Ty: kto zyska, kto straci do 2030?

Odkryj, jakie niespodziewane profesje powstają dzięki AI w Polsce. Kompletny przewodnik po przyszłości pracy. Sprawdź, czy jesteś gotów na tę rewolucję!